OpenClaw & AI Operasional

Cara Ubah Max Context di Config OpenClaw Saat Pakai Custom Provider

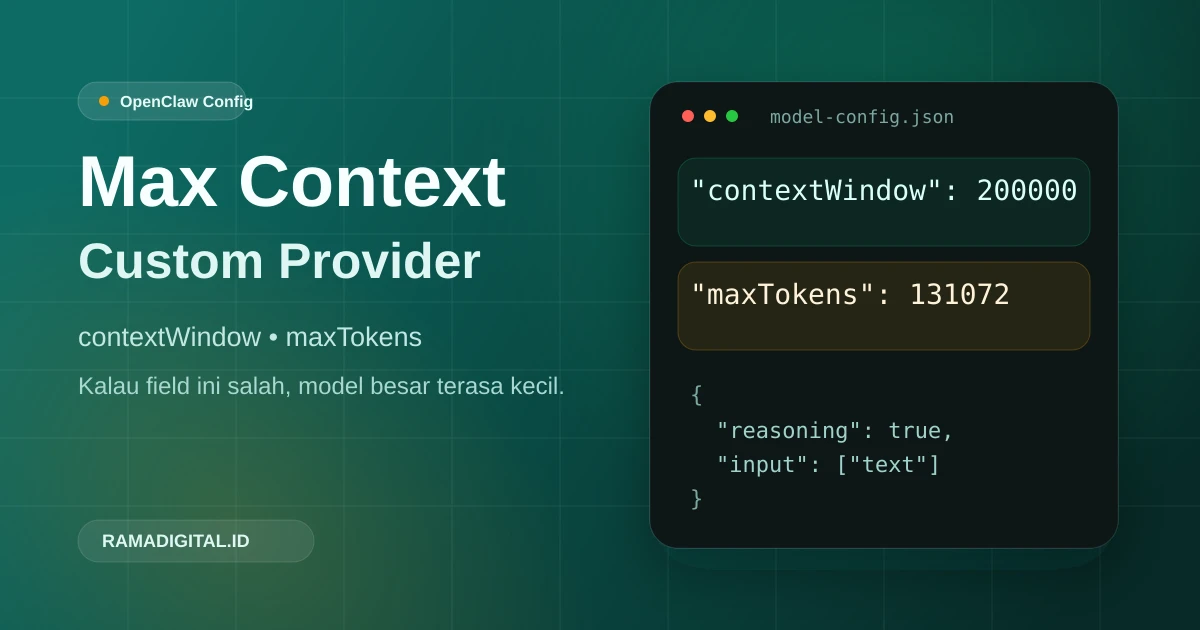

Kalau pakai custom provider di OpenClaw, model sering terasa cepat lupa konteks atau output pendek. Artikel ini menjelaskan fungsi contextWindow dan maxTokens, cara setting yang benar, serta kesalahan yang paling sering terjadi.

Kalau Anda pakai custom provider di OpenClaw, ada satu masalah yang cukup sering muncul: model memang jalan, tapi context window terasa pendek. Chat cepat lupa konteks, input panjang kepotong, atau output terasa pendek padahal model aslinya harusnya bisa lebih lega.

Dalam banyak kasus, problem-nya bukan karena OpenClaw jelek atau modelnya lemah. Problem-nya justru lebih sederhana: metadata model di config belum diisi lengkap.

Dan dua field yang paling sering jadi akar masalah adalah:

contextWindowmaxTokens

Kalau dua ini tidak diatur dengan benar, Anda bisa berakhir memakai model besar dengan setup kecil.

Kenapa Masalah Ini Sering Terjadi?

Saat pakai provider bawaan, metadata model biasanya sudah lebih rapi. Tapi saat pakai custom provider, banyak orang cuma fokus ke hal-hal ini:

- base URL,

- auth header,

- model ID,

- endpoint format.

Lalu mereka berhenti di sana karena model sudah bisa dipanggil.

Padahal, “bisa jalan” bukan berarti “sudah optimal”. Kalau OpenClaw tidak tahu kapasitas konteks model dengan benar, hasilnya bisa terasa seperti model punya memory pendek — padahal batas aslinya sebenarnya jauh lebih besar.

Bedanya contextWindow dan maxTokens

Ini dua istilah yang kelihatannya mirip, tapi fungsinya beda.

contextWindow

Ini kapasitas total konteks yang bisa dibawa dalam satu request.

Masuk ke sini antara lain:

- system prompt,

- chat history,

- user message,

- tool context,

- dan token lain yang ikut dikirim ke model.

Kalau nilainya terlalu kecil, model akan terasa cepat lupa konteks atau terlalu cepat memotong riwayat yang relevan.

maxTokens

Ini batas output maksimal yang bisa dihasilkan model dalam satu respons.

Kalau nilainya terlalu kecil, hasilnya bisa seperti ini:

- jawaban kepotong di tengah,

- artikel panjang berhenti prematur,

- output code tidak selesai,

- reasoning terasa terlalu pendek.

Jadi singkatnya:

contextWindow= seberapa banyak model bisa “ingat” dalam satu requestmaxTokens= seberapa panjang model bisa “ngomong” dalam output

Contoh Config yang Perlu Diperhatikan

Kalau Anda menambahkan model custom di OpenClaw, strukturnya biasanya kurang lebih seperti ini:

{

"models": {

"mode": "merge",

"providers": {

"nama-provider": {

"baseUrl": "https://api.example.com",

"models": [

{

"id": "nama-model",

"name": "Nama Model",

"reasoning": true,

"input": ["text"],

"contextWindow": 200000,

"maxTokens": 131072

}

]

}

}

}

}Dua field yang paling penting di sini adalah:

contextWindowmaxTokens

Contoh Kasus yang Sering Salah

Banyak orang mendaftarkan model custom hanya sampai tahap seperti ini:

{

"id": "my-model",

"name": "My Model"

}Secara teknis, model mungkin tetap bisa dipanggil. Tapi OpenClaw tidak punya informasi cukup tentang kapasitas input dan output model tersebut.

Lebih aman kalau metadata modelnya ditulis lebih lengkap seperti ini:

{

"id": "my-model",

"name": "My Model",

"reasoning": true,

"input": ["text"],

"contextWindow": 128000,

"maxTokens": 8192

}Atau kalau model memang punya kapasitas besar:

{

"id": "my-model-large",

"name": "My Model Large",

"reasoning": true,

"input": ["text"],

"contextWindow": 200000,

"maxTokens": 131072

}Tentu angka ini harus mengikuti spesifikasi asli model dari provider Anda. Jangan asal isi besar hanya supaya terlihat keren. Kalau nilainya lebih besar dari batas asli provider, request justru bisa error atau tidak stabil.

Cara Menentukan Angka yang Benar

Urutannya sederhana:

- cek dokumentasi provider atau model yang dipakai,

- cari informasi maximum context window dan maximum output tokens,

- map angkanya ke

contextWindowdanmaxTokens, - uji dengan input dan output yang cukup panjang.

Kalau dokumentasi provider pakai istilah lain seperti:

- context length,

- input token limit,

- output token limit,

Anda tinggal cocokkan maknanya ke dua field tadi.

Kapan Anda Perlu Ubah Setting Ini?

Biasanya Anda perlu cek dan ubah config ini kalau:

- baru menambahkan custom provider,

- model terasa cepat lupa instruksi awal,

- chat panjang terasa cepat kehilangan konteks,

- output sering kepotong di tengah,

- Anda pakai model untuk task panjang seperti coding, blueprint, artikel, atau analisis multi-step.

Kalau workflow Anda ringan dan pendek, masalah ini mungkin tidak terlalu terasa. Tapi untuk use case serius, setting ini sangat menentukan kualitas hasil.

Kesalahan yang Paling Sering Terjadi

1. Mengira model otomatis tahu context-nya

Tidak selalu. Untuk provider custom, metadata model sering harus Anda lengkapi sendiri.

2. Menyamakan contextWindow dengan maxTokens

Keduanya beda fungsi. Satu untuk total konteks, satu untuk output maksimal.

3. Mengisi angka terlalu besar tanpa cek spesifikasi asli

Hasilnya bukan performa lebih bagus, tapi potensi error lebih besar.

4. Fokus ke provider, lupa ke model

Dalam satu provider, tiap model bisa punya limit yang berbeda.

Best Practice Sederhana

Kalau mau aman, pegang aturan ini:

- isi

contextWindowsesuai spesifikasi model, - isi

maxTokenssesuai limit output model, - dokumentasikan sumber angkanya,

- uji dengan prompt panjang,

- uji dengan output panjang,

- cek apakah kualitas respons lebih stabil setelah setting diperbaiki.

Kalau perlu, buat catatan kecil per model berisi:

- provider,

- model ID,

- context window,

- max output,

- reasoning support,

- input type.

Ini kelihatan sepele, tapi sangat membantu saat debug atau saat Anda mulai punya banyak model custom.

Contoh Dampak Nyata Kalau Context Salah

Misalnya Anda pakai OpenClaw untuk:

- menulis artikel panjang,

- analisis repo,

- membuat blueprint project,

- reasoning multi-step,

- atau task coding dengan banyak konteks.

Kalau contextWindow config terlalu kecil, efeknya biasanya langsung terasa:

- model cepat lupa instruksi awal,

- kualitas jawaban turun di tengah percakapan,

- atau hasil terasa seperti model “pendek umur”.

Di titik itu, problem-nya belum tentu modelnya jelek. Sering kali problem-nya cuma karena config metadata model belum benar.

Kesimpulan

Kalau Anda pakai custom provider di OpenClaw dan merasa model cepat lupa konteks atau output sering kepotong, hal pertama yang perlu dicek adalah:

contextWindowmaxTokens

Karena banyak kasus bukan error besar, tapi cuma metadata model yang belum lengkap.

Jadi jangan cuma daftarkan model sampai “bisa jalan”. Pastikan model juga didaftarkan dengan kapasitas yang benar. Kalau tidak, Anda sedang pakai model besar dengan setup kecil.

Kalau Anda ingin setup custom provider di OpenClaw lebih rapi, stabil, dan sesuai kapasitas model yang sebenarnya, RamaDigital bisa bantu audit config, struktur provider, dan workflow operasionalnya supaya tidak sekadar jalan, tapi benar-benar enak dipakai.

Tag Artikel

Artikel Terkait

Temukan lebih banyak konten menarik yang mungkin Anda sukai

Tentang Penulis

Rama Aditya

Profesional dengan pengalaman 15+ tahun dalam digital marketing, fullstack development, dan konsultasi bisnis. Fokus membantu bisnis Indonesia membangun sistem yang efisien, scalable, dan berdampak langsung ke pertumbuhan bisnis.

Pelajari Tentang Kami