OpenClaw & AI Operasional

Apa Arti `Text: low` di OpenClaw Status? Ini Maksudnya dan Cara Mengubahnya

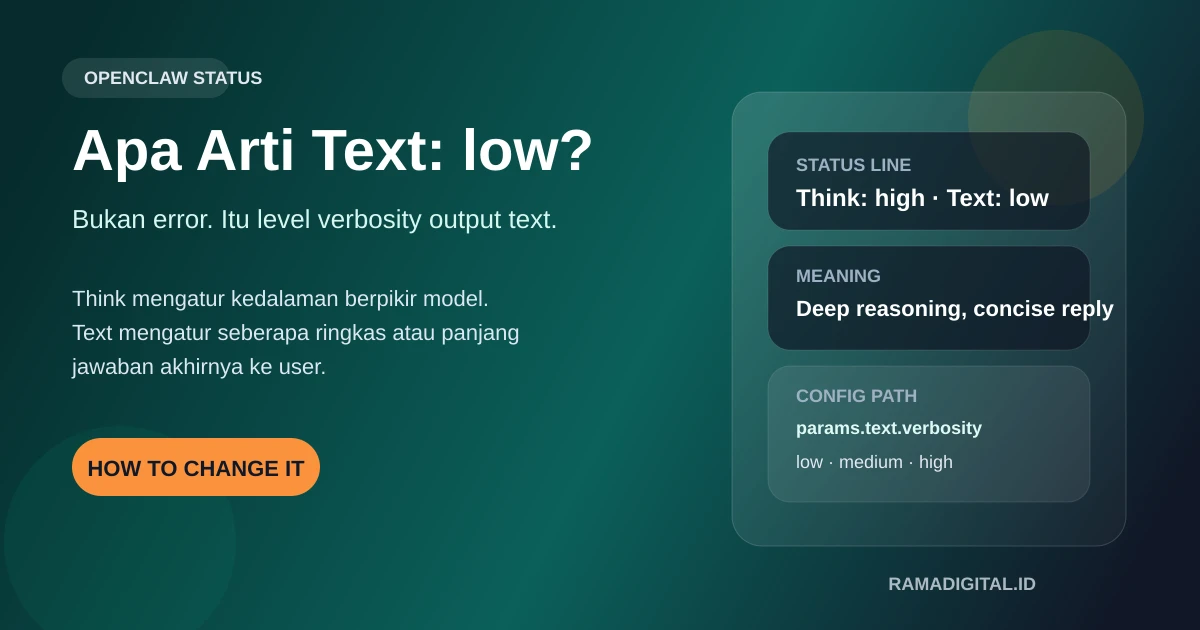

`Text: low` di OpenClaw bukan error dan bukan berarti model lemah. Itu adalah level verbosity output text. Ini penjelasan artinya, bedanya dengan `Think: high`, dan cara mengubahnya.

Kalau Anda melihat status OpenClaw seperti ini:

Runtime: direct · Think: high · Text: low · elevated

lalu bertanya, "Text: low itu maksudnya apa?", jawabannya cukup penting karena ini sering disalahpahami.

Text: low bukan error, bukan tanda model sedang lemah, dan bukan berarti kualitas jawabannya diturunkan. Yang diturunkan adalah panjang/detail output teks akhirnya, bukan kualitas reasoning di belakang layar.

Kalau harus diringkas satu kalimat:

Text: low artinya OpenClaw sedang meminta model untuk tetap menjawab lebih ringkas, lebih hemat kata, dan lebih to-the-point.

Ringkasan Cepat

Kalau Anda melihat status seperti ini:

Think: highText: low

maka artinya:

- model diminta berpikir lebih dalam,

- tapi jawaban akhirnya tetap dibuat ringkas.

Jadi kombinasi ini sebenarnya sangat masuk akal untuk workflow operasional.

Model tetap melakukan reasoning yang lebih serius di belakang layar, tapi output ke user tidak berubah menjadi essay panjang setiap kali menjawab.

Ini sangat cocok untuk kasus seperti: - Telegram assistant, - workflow approval, - operasional harian, - coding assistant yang perlu action cepat, - dan percakapan yang lebih enak dibaca tanpa noise berlebih.

Bedanya Think dan Text di OpenClaw

Ini bagian yang paling penting.

Think

Think mengacu ke thinking level / reasoning effort.

Kalau nilainya high, berarti model didorong untuk:

- berpikir lebih hati-hati,

- mempertimbangkan langkah lebih dalam,

- dan biasanya lebih kuat untuk task yang butuh analisis atau eksekusi kompleks.

Singkatnya:

Think = seberapa dalam model berpikir.

Text

Text mengacu ke verbosity output text.

Kalau nilainya low, berarti model diminta untuk:

- lebih ringkas,

- tidak terlalu panjang,

- tidak terlalu memo-like,

- dan tidak terlalu banyak basa-basi di jawaban akhir.

Singkatnya:

Text = seberapa panjang atau detail jawaban akhirnya.

Jadi dua hal ini beda.

Model bisa: - Think: high → reasoning dalam - Text: low → jawaban tetap pendek

Itu bukan kontradiksi. Justru ini kombinasi yang sering paling enak dipakai di chat operasional.

Kenapa Text: low muncul di status?

Di OpenClaw versi baru, terutama jalur GPT-5 dan Codex, ada perubahan yang memang mendorong output menjadi lebih ringkas.

Di changelog OpenClaw ada poin yang secara substansi mengatakan bahwa: - GPT-5 dan Codex dibuat lebih cepat bertindak, - default reply dibuat lebih rendah verbosity, - dan reply dibuat lebih chat-like, tidak terlalu memo panjang.

Artinya, kalau Anda melihat Text: low, itu biasanya menandakan bahwa effective text verbosity yang aktif saat ini memang low, baik karena:

- default behavior model/provider di runtime, atau

- ada setting explicit di config.

Di instance tertentu, path config-nya mungkin belum diset manual, tapi status tetap bisa menunjukkan Text: low karena itulah effective value yang sedang dipakai runtime.

Apakah Text: low jelek?

Tidak.

Malah untuk banyak use case, ini justru lebih bagus.

Cocok untuk:

- chat Telegram / WhatsApp style,

- assistant operasional,

- approval flow,

- percakapan cepat,

- sesi yang butuh action lebih dulu daripada narasi panjang.

Kurang cocok untuk:

- jawaban edukatif yang memang perlu detail panjang,

- penjelasan teknis yang step-by-step lengkap,

- artikel atau draft penulisan panjang,

- sesi eksplorasi yang sengaja ingin verbose.

Jadi Text: low bukan sesuatu yang harus selalu diubah. Ini tergantung gaya output yang Anda inginkan.

Kapan sebaiknya diubah ke medium atau high?

Pakai low kalau Anda ingin:

- jawaban cepat,

- balasan singkat,

- minim basa-basi,

- gaya operasional yang efisien.

Pakai medium kalau Anda ingin:

- jawaban masih cukup ringkas,

- tapi sedikit lebih dijelaskan,

- cocok untuk mayoritas workflow harian.

Pakai high kalau Anda ingin:

- jawaban panjang,

- penjelasan lengkap,

- lebih banyak konteks dan elaborasi.

Kalau saya tarik praktis:

- Telegram / operasional harian → low atau medium

- penjelasan teknis / konsultasi panjang → medium atau high

Cara mengubah Text: low di OpenClaw

Dari jalur yang saya verifikasi langsung, cara paling aman sekarang adalah lewat config model params.

Path yang bisa dipakai untuk model Codex OAuth misalnya:

openclaw config set 'agents.defaults.models["openai-codex/gpt-5.4"].params.text.verbosity' '"medium"' --strict-json

Kalau mau ubah ke high:

openclaw config set 'agents.defaults.models["openai-codex/gpt-5.4"].params.text.verbosity' '"high"' --strict-json

Kalau mau pakai low lagi:

openclaw config set 'agents.defaults.models["openai-codex/gpt-5.4"].params.text.verbosity' '"low"' --strict-json

Kalau Anda memakai jalur OpenAI biasa, bukan Codex OAuth, path-nya bisa setara seperti ini:

openclaw config set 'agents.defaults.models["openai/gpt-5.4"].params.text.verbosity' '"medium"' --strict-json

Kalau mau edit manual di openclaw.json

Anda juga bisa set langsung di config JSON seperti ini:

{

"agents": {

"defaults": {

"models": {

"openai-codex/gpt-5.4": {

"params": {

"text": {

"verbosity": "medium"

}

}

}

}

}

}

}

Kalau perlu untuk model OpenAI biasa juga, tinggal tambahkan blok serupa untuk:

openai/gpt-5.4

Perlu restart atau tidak?

Secara praktik, setelah ubah config seperti ini, paling aman lakukan salah satu dari ini: - mulai session baru, - reset session yang lama, - atau restart gateway kalau memang ingin memastikan semua runtime state ikut segar.

Kenapa? Karena status session yang sudah berjalan kadang masih membawa effective state yang aktif di session itu, bukan langsung seluruhnya mengikuti rasa config baru di tengah jalan.

Apakah ada command chat khusus untuk ubah Text?

Untuk saat artikel ini disiapkan, jalur yang paling jelas dan terverifikasi adalah lewat config model params seperti contoh di atas.

Saya belum menemukan shortcut chat command resmi yang terdokumentasi sejelas pengaturan Think, jadi kalau Anda ingin hasil yang pasti dan konsisten, jalur config tetap yang paling aman.

Kombinasi setting yang saya rekomendasikan

Kalau Anda bingung mau set apa, ini guideline yang paling praktis.

Untuk assistant operasional / Telegram

Think: highText: low

Hasilnya: - model tetap serius berpikir, - tapi jawaban akhirnya tetap ringkas dan enak dibaca.

Untuk konsultasi teknis yang butuh penjelasan lebih panjang

Think: highText: medium

Hasilnya: - tetap cerdas di reasoning, - tapi penjelasan tidak terlalu pendek.

Untuk drafting / penjelasan panjang

Think: highText: high

Hasilnya: - model akan cenderung lebih elaboratif, - cocok untuk konten atau penjelasan yang sengaja ingin komprehensif.

Kesimpulan

Text: low di OpenClaw artinya level verbosity output text sedang dibuat rendah atau ringkas.

Itu bukan error. Itu juga bukan tanda model jadi lebih bodoh. Yang berubah adalah gaya jawaban akhirnya, bukan kemampuan berpikirnya.

Kalau dipasangkan dengan Think: high, hasilnya justru sering ideal untuk kerja harian:

- model tetap berpikir serius,

- tapi jawabannya tidak melebar ke mana-mana.

Kalau Anda ingin output lebih detail, ubah saja text.verbosity ke medium atau high lewat config model params.

Kalau mau diringkas satu baris:

Think mengatur kedalaman berpikir, Text mengatur kepanjangan jawaban.

Artikel Terkait

Temukan lebih banyak konten menarik yang mungkin Anda sukai

Tentang Penulis

Rama Aditya

Profesional dengan pengalaman 15+ tahun dalam digital marketing, fullstack development, dan konsultasi bisnis. Fokus membantu bisnis Indonesia membangun sistem yang efisien, scalable, dan berdampak langsung ke pertumbuhan bisnis.

Pelajari Tentang Kami