Masalah besar dalam A/B testing bukan cuma test yang setup-nya jelek.

Masalah yang lebih mahal sering datang setelah itu: Anda merasa sudah menemukan winner, padahal sebenarnya belum.

Di dashboard, varian A terlihat lebih bagus. CTR naik. CPL turun. ROAS terlihat lebih manis. Lalu keputusan diambil cepat: matikan yang kalah, scale yang menang.

Beberapa hari kemudian, hasilnya ambruk.

Inilah yang sering disebut sebagai false winner -- pemenang semu yang terlihat menang karena data belum cukup, distribusi belum stabil, atau keputusan diambil terlalu cepat.

Kalau Anda sering merasa test Meta Ads "bagus di awal lalu rusak di belakang", besar kemungkinan masalahnya bukan cuma creative atau audience. Masalahnya bisa ada di cara Anda membaca ketidakpastian data.

Kalau belum baca fondasinya, mulai dari sini dulu: Cara Baca Hasil A/B Testing Meta Ads dengan Benar: Jangan Salah Pilih Winner

Kenapa False Winner Sering Terjadi?

Ada empat penyebab yang paling sering.

1. Data masih terlalu kecil

Kalau volume result masih tipis, selisih kecil terlihat besar. Di titik ini, dashboard mudah memancing overconfidence.

Misalnya satu varian baru menghasilkan sedikit konversi lalu terlihat unggul jauh. Secara visual memang meyakinkan. Tapi secara eksperimen, data sekecil itu belum tentu cukup untuk menyimpulkan ada perbedaan nyata.

2. Peeking: terlalu sering melihat angka lalu buru-buru mengambil keputusan

Dalam metodologi eksperimen, ini salah satu jebakan terbesar. Evan Miller menjelaskan bahaya repeated significance testing atau kebiasaan mengecek hasil terus-menerus lalu berhenti saat angka terlihat bagus.

Masalahnya: semakin sering Anda "mengintip" hasil dan membuat keputusan prematur, semakin besar kemungkinan Anda tertipu noise.

3. KPI yang dipilih salah

Kalau objective Anda leads, tapi winner dipilih dari CTR, maka Anda sedang memilih creative yang paling pandai mengundang klik -- bukan yang paling efisien menghasilkan lead.

Ini bukan salah statistik. Ini salah prioritas.

4. Meta Ads sendiri bekerja dalam sistem delivery yang dinamis

Meta menjelaskan adanya fase learning dan dampak dari perubahan signifikan terhadap delivery. Jadi performa awal memang bisa terlihat naik-turun sebelum stabil. Artinya, test Meta Ads memang punya lapisan volatilitas praktis yang membuat false winner semakin mudah muncul kalau advertiser tergesa-gesa.

Apa Itu Statistical Significance, dengan Bahasa yang Waras?

Secara sederhana, statistical significance membantu menjawab pertanyaan ini:

"Apakah perbedaan hasil antara dua varian kemungkinan memang nyata, atau cuma kebetulan dari sample yang masih kecil?"

Optimizely menjelaskan konsep ini dengan menekankan hubungan antara confidence level, false positive, dan false negative.

Bahasa gampangnya:

- False positive = Anda mengira ada winner, padahal sebenarnya tidak ada perbedaan nyata.

- False negative = Anda mengira tidak ada pemenang, padahal sebenarnya ada.

Di dunia ads, false positive biasanya lebih mahal. Karena begitu winner palsu di-scale, budget ikut kebuang.

Masalahnya: Significance Bukan Tombol Ajaib

Ini penting.

Banyak marketer mendengar istilah "significant", lalu merasa itu berarti keputusan sudah aman 100%.

Tidak begitu.

Significance hanyalah salah satu alat bantu. Ia tidak otomatis membersihkan:

- setup test yang bias,

- objective yang salah,

- measurement yang jelek,

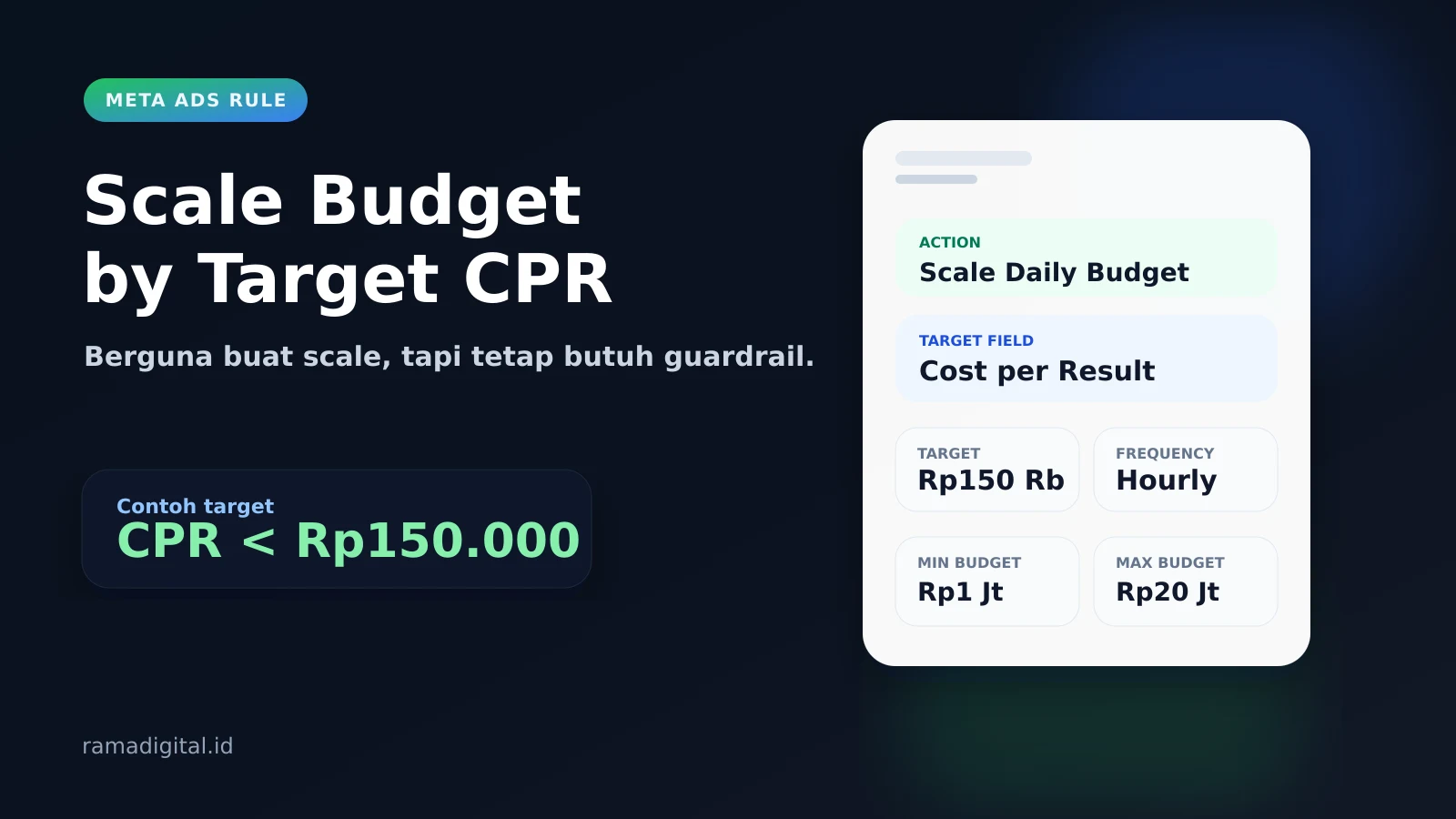

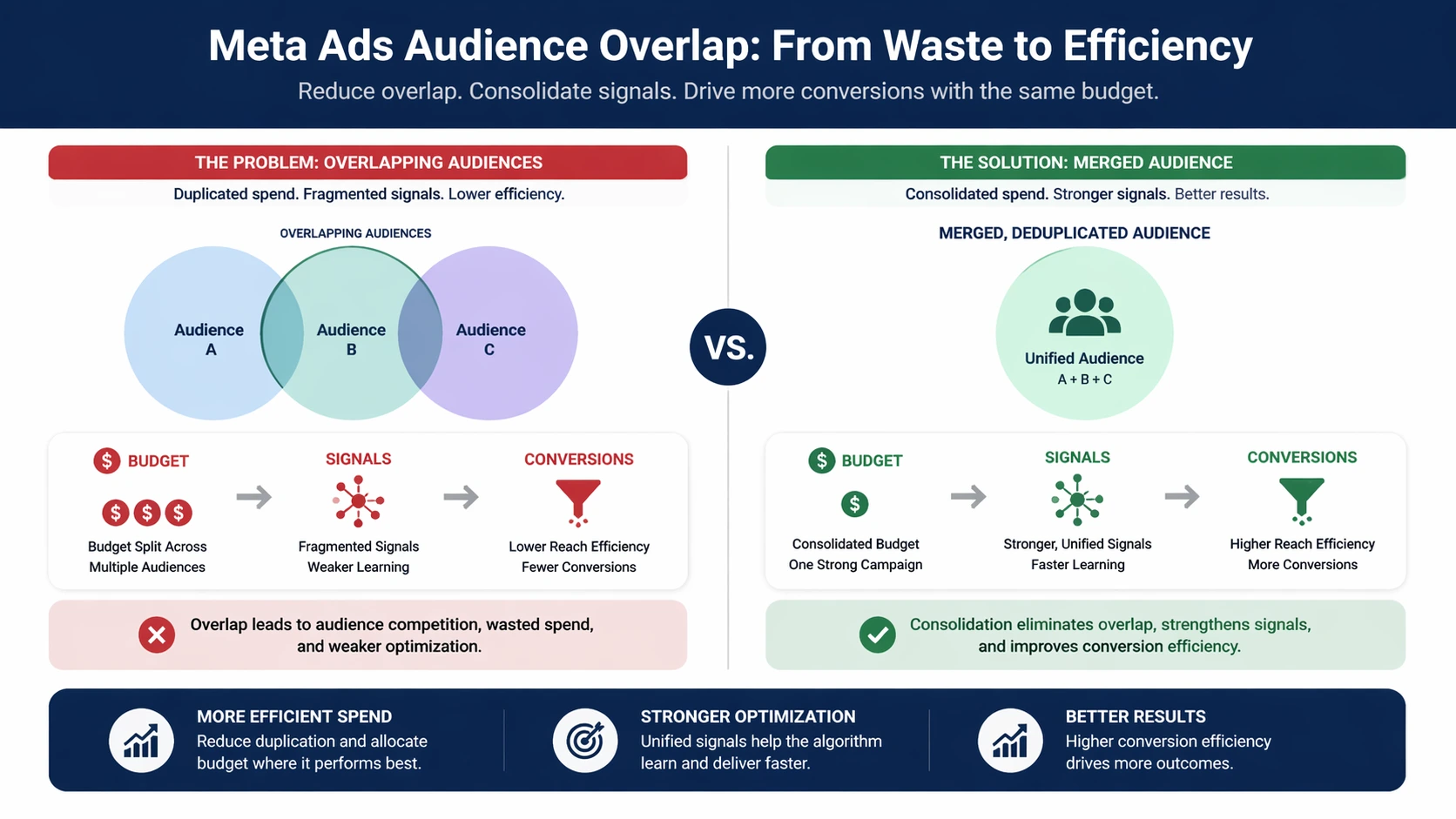

- audience overlap,

- perubahan setup di tengah jalan,

- atau creative fatigue yang datang setelah test.

Jadi kalau ada angka yang terlihat "significant", tapi eksperimennya sendiri kotor, hasilnya tetap bisa menyesatkan.

Kenapa Peeking Itu Berbahaya?

Evan Miller menjelaskan dengan sangat jelas: kalau Anda terus mengecek hasil dan berhenti begitu salah satu varian terlihat unggul, Anda menaikkan peluang menemukan winner palsu.

Ini sangat mirip dengan kebiasaan umum di Meta Ads:

- pagi cek,

- siang cek lagi,

- malam cek lagi,

- besok pagi lihat selisihnya bagus,

- langsung matikan satu varian.

Secara operasional ini terasa gesit. Tapi secara eksperimen ini bisa kacau.

Semakin sering Anda melihat dan bereaksi, semakin besar peluang noise diperlakukan sebagai sinyal.

Jadi, Kapan Test Sebaiknya Dihentikan?

Tidak ada satu angka universal yang cocok untuk semua akun, niche, dan objective. Tapi stopping rule yang sehat biasanya dibangun dari kombinasi ini.

1. Ada KPI utama yang jelas dari awal

Tanpa KPI utama, stopping rule jadi liar.

Contoh:

- lead gen → cost per lead / cost per qualified lead

- purchase → cost per purchase / ROAS

- messaging → cost per qualified conversation

2. Ada ekspektasi sample yang masuk akal

Sebelum test jalan, setidaknya Anda perlu gambaran:

- berapa baseline conversion rate,

- berapa minimum lift yang dianggap berarti,

- kira-kira butuh berapa result untuk mulai percaya diri.

Di sini tools seperti sample size calculator dari Evan Miller atau referensi VWO sangat berguna. Bukan untuk membuat keputusan terasa akademis, tapi supaya advertiser tidak asal stop saat data masih terlalu tipis.

3. Jangan stop hanya karena angka sedang terlihat cantik

Kalau satu varian unggul sebentar lalu langsung dimenangkan, Anda berisiko memilih false winner. Lebih sehat kalau test dihentikan setelah:

- KPI utama unggul dengan pola yang lebih konsisten,

- sample sudah masuk akal,

- delivery tidak sedang kacau,

- dan tidak ada perubahan setup yang mencampur data.

4. Jangan biarkan test berjalan tanpa keputusan juga

Sebaliknya, terlalu lama menunda keputusan juga tidak sehat.

Kalau data sudah cukup, selisih makin jelas, dan objective utama sudah terpenuhi, menunda keputusan hanya membuang waktu. Tujuan statistik bukan membuat marketer lumpuh. Tujuannya membuat keputusan lebih waras.

Framework Operasional yang Lebih Aman

Kalau mau sederhana, pakai framework ini.

Sebelum test

- tentukan KPI utama,

- tentukan hipotesis,

- estimasikan sample yang masuk akal,

- set ekspektasi minimum lift yang dianggap penting.

Saat test berjalan

- jangan terlalu sering peeking untuk mengambil keputusan,

- hindari edit setup yang mencampur data,

- catat jika ada perubahan yang memang terpaksa dilakukan.

Saat membaca hasil

- lihat KPI utama dulu,

- cek apakah volume result cukup,

- cek apakah perbedaan bertahan, bukan cuma meledak sebentar,

- cek apakah ada faktor lain yang mungkin mengacaukan test.

Saat memutuskan winner

- pastikan winner menang di metrik yang memang penting untuk bisnis,

- jangan scale hanya karena vanity metric lebih cantik,

- dokumentasikan konteks test supaya winner tidak dibaca keluar konteks.

Apa Hubungannya dengan Meta Learning Phase?

Hubungannya besar.

Meta menjelaskan bahwa ad set bisa masuk ke fase learning, dan perubahan signifikan bisa memengaruhi delivery. Secara praktis, ini berarti performa awal sering lebih noisy daripada yang banyak advertiser kira.

Jadi kalau Anda peeking terlalu cepat di Meta Ads, Anda sedang mencampur dua hal sekaligus:

- noise statistik dari sample kecil,

- dan noise delivery dari sistem yang belum stabil.

Itu kombinasi yang ideal untuk melahirkan false winner.

Jangan Campur Statistik dengan Kepercayaan Diri Palsu

Salah satu jebakan paling halus dalam eksperimen adalah merasa "sudah data-driven" hanya karena sering melihat angka.

Padahal melihat angka tidak sama dengan memahami eksperimen.

Kalau stopping rule tidak jelas, KPI utama tidak tepat, dan keputusan dibuat karena tidak sabar, maka dashboard hanya memberi ilusi kepastian.

Yang sebenarnya dibutuhkan bukan lebih banyak screenshot performa. Yang dibutuhkan adalah disiplin:

- tahu metrik mana yang utama,

- tahu kapan data masih terlalu rapuh,

- tahu kapan harus berhenti,

- dan tahu bahwa tidak semua selisih layak disebut insight.

Fakta vs Inference

Fakta dari sumber resmi / metodologi

- Meta punya learning phase dan significant edits dapat memengaruhi delivery.

- Statistical significance dipakai untuk menilai apakah selisih kemungkinan nyata atau kebetulan.

- Repeated significance testing / peeking meningkatkan risiko keputusan yang salah.

- Sample size berpengaruh besar pada kualitas keputusan eksperimen.

Inference operasional

- False winner di Meta Ads sangat sering lahir dari kombinasi sample kecil + peeking + dashboard noise.

- Stopping rule sebaiknya ditetapkan sebelum test, bukan setelah angka terlihat menarik.

- Significance tidak bisa menyelamatkan eksperimen yang setup-nya kotor.

Kesimpulan

Di Meta Ads, winner yang terlihat paling cepat belum tentu winner yang paling benar.

Kalau Anda ingin A/B testing jadi alat keputusan yang serius, jangan cuma fokus pada siapa yang unggul duluan. Fokus juga pada:

- apakah datanya cukup,

- apakah test-nya bersih,

- apakah objective bisnisnya benar,

- dan apakah Anda berhenti karena aturan yang waras, bukan karena angka kebetulan terlihat seksi.

Karena kadang, keputusan paling mahal bukan saat test kalah. Keputusan paling mahal justru saat Anda terlalu cepat percaya bahwa test sudah menang.

Baca juga

- Cara Baca Hasil A/B Testing Meta Ads dengan Benar: Jangan Salah Pilih Winner

- Kenapa Hasil A/B Testing Meta Ads Bisa Menyesatkan Kalau Measurement Anda Jelek

- A/B Testing Meta Ads yang Benar: Jangan Ubah Semua Sekaligus Kalau Mau Insight yang Akurat

Referensi

Sumber resmi Meta

- https://www.facebook.com/help/messenger-app/650774041651557/

- https://www.facebook.com/help/messenger-app/289211751238030

- https://www.facebook.com/business/ads/pricing

- https://www.facebook.com/business/ads/performance-marketing

Sumber metodologi eksperimen

- https://support.optimizely.com/hc/en-us/articles/4410284003341-Statistical-significance

- https://www.evanmiller.org/how-not-to-run-an-ab-test.html

- https://www.evanmiller.org/ab-testing/sample-size.html

- https://cxl.com/blog/ab-testing-statistics/

- https://cxl.com/es/blog/stopping-ab-tests-how-many-conversions-do-i-need/

- https://vwo.com/glossary/sample-size/